OpenAI允许客户现在可以在GPT-3.5 Turbo这个轻量级版本上使用自定义数据,从而更容易地在构建特定行为时提高这个文本生成AI模型的可靠性。

OpenAI声称,经过微调的GPT-3.5版本在“某些狭窄任务”上可以匹配甚至超过公司的旗舰模型GPT-4的基础功能。

“自GPT-3.5 Turbo发布以来,开发者和企业都要求能够定制模型,以为他们的用户创造独特和差异化的体验,”公司在今天下午发布的博客文章中写道。“这次更新使开发者能够为他们的用例定制更高性能的模型,并以大规模方式运行这些定制模型。”

通过微调,使用OpenAI API的GPT-3.5 Turbo的公司可以使模型更好地遵循指令,例如使其始终以给定的语言进行响应。或者,他们可以提高模型一致性地格式化响应的能力(例如,用于完成代码片段),以及改进模型输出的“感觉”,比如其语调,使其更符合品牌或声音。

此外,微调使OpenAI的客户能够缩短他们的文本提示,以加速API调用并降低成本。“早期测试者通过微调指令到模型本身,已经将提示大小缩减了高达90%”,OpenAI在博客文章中声称。

微调目前需要准备数据,上传必要的文件,并通过OpenAI的API创建一个微调工作。所有微调数据必须通过一个“审查”API和一个由GPT-4驱动的审查系统,以查看它是否与OpenAI的安全标准冲突,公司表示。但OpenAI计划在未来推出一个带有用于检查正在进行的微调工作状态的仪表板的微调UI。

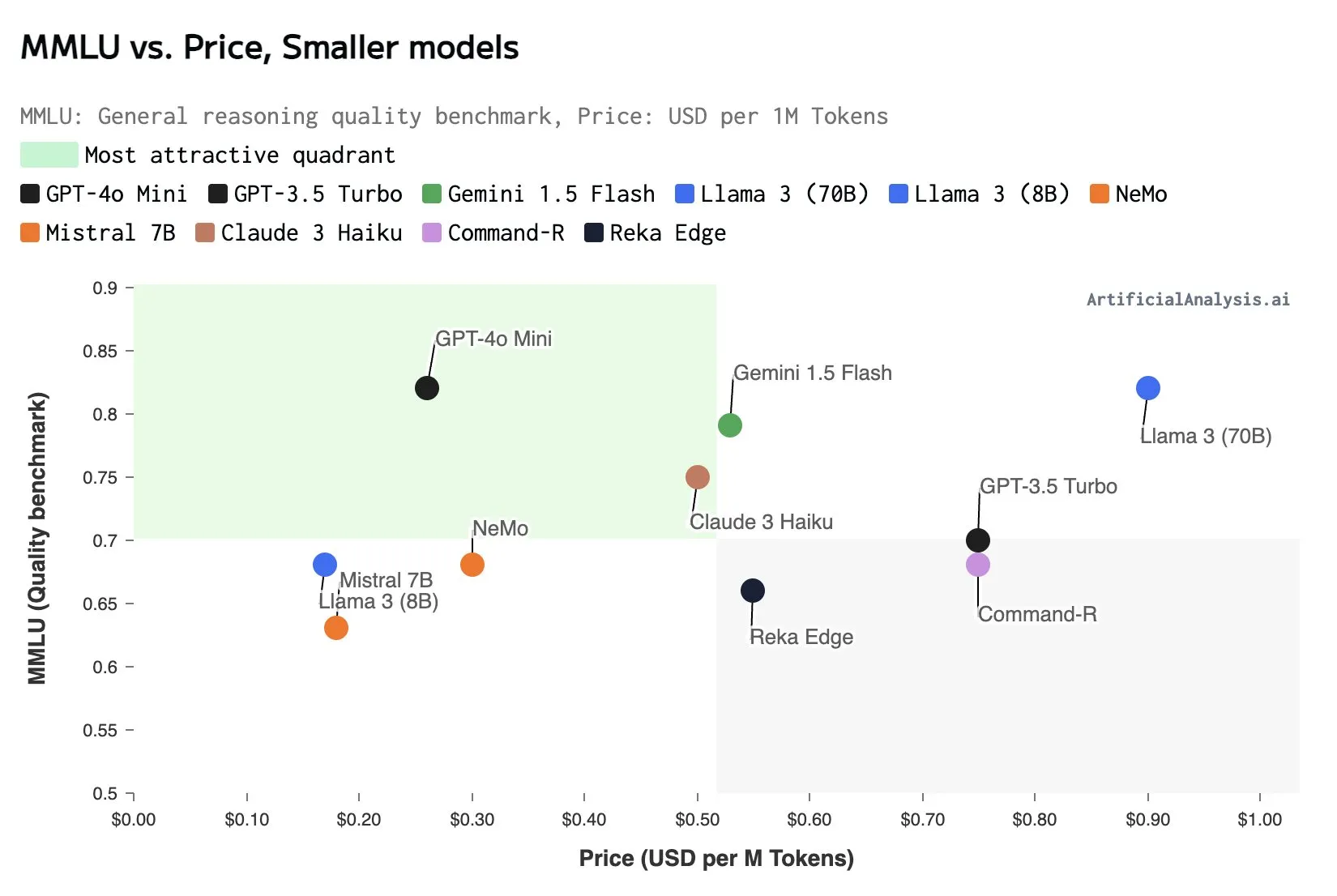

关于微调的费用按照以下方式:

- 训练:$0.008 / 1K tokens

- 使用输入:$0.012 / 1K tokens

- 使用输出:$0.016 / 1K tokens

“Tokens”表示原始文本——例如,单词“fantastic”可以被分为“fan”、“tas”和“tic”三个tokens。OpenAI表示,一个使用100,000 tokens(或大约75,000单词)的训练文件的GPT-3.5 Turbo微调任务大约会花费$2.40。

另外的新闻是,OpenAI今天发布了两个更新过的GPT-3基础模型(babbage-002和davinci-002),这两个模型也支持微调,还支持分页和“更多的可扩展性”。如之前宣布的,OpenAI计划在2024年1月4日退役原始的GPT-3基础模型。

OpenAI表示,GPT-4的微调支持——与GPT-3.5不同,GPT-4除了能理解文本外还能理解图像——将在今年秋季的某个时候到来,但没有提供更多具体的信息。